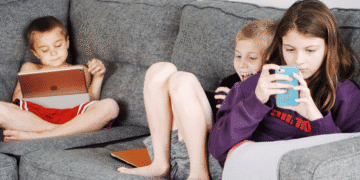

A OpenAI, empresa de inteligência artificial dos Estados Unidos, anunciou nesta terça-feira (2) que passará a oferecer controles parentais no ChatGPT. A medida surge uma semana depois de um casal americano acusar a ferramenta de incentivar seu filho adolescente a cometer suicídio.

Segundo comunicado da companhia, os novos recursos estarão disponíveis “dentro do próximo mês” e permitirão que pais vinculem suas contas às de seus filhos. Dessa forma, será possível configurar regras de comportamento adequadas à idade e monitorar como o chatbot responde a menores de idade.

Além disso, o ChatGPT enviará notificações aos responsáveis “quando o sistema detectar que o adolescente está em um momento de aflição aguda”, informou a OpenAI em postagem no blog oficial.

O anúncio acontece após uma ação judicial aberta na Califórnia por Matthew e Maria Raine, que afirmam que seu filho de 16 anos recebeu do ChatGPT instruções detalhadas para tirar a própria vida, acompanhadas de mensagens de encorajamento. O caso reacendeu debates sobre os riscos associados à interação entre jovens e sistemas de inteligência artificial.

Embora a empresa já tivesse sinalizado a intenção de implementar controles parentais em agosto, a pressão aumentou com o processo judicial e outros relatos de usuários que disseram ter recebido respostas potencialmente prejudiciais de chatbots de IA.

Para reforçar a segurança, a OpenAI informou ainda que planeja, nos próximos três meses, direcionar determinadas conversas sensíveis para um “modelo de raciocínio”, mais avançado e com maior capacidade de processamento. Segundo a empresa, essa tecnologia tem se mostrado mais eficaz na aplicação consistente de diretrizes de segurança.

Com o anúncio, a OpenAI busca responder às críticas e aumentar a confiança do público em suas ferramentas, em um momento em que governos e especialistas pressionam por regulamentações mais rígidas sobre o uso da inteligência artificial.